SeeDance ist ein KI-Videomodell des Unternehmens ByteDance. Es generiert aus Text-Prompts und Bildern „cinematic“ wirkende Videos. Seit ende Februar 2026 gibt es SeeDance 2.0. Es legt einen stärkeren Fokus auf die multimodale Erstellung (Text/Bild/Audio/Video) und bietet mehr Kontrolle per natürlicher Sprache.

Ich habe SeeDance 2 in den letzten Tagen getestet. Die Ergebnisse wirken weniger wie zufällige KI-Clips und mehr wie kurze, bewusst „gefilmte“ Sequenzen - vor allem, wenn dem Modell klare Aufnahmen vorgegeben werden (Kamera folgt, seitliche Verfolgung, Close-up usw.).

In diesem Artikel erfährst du, wie du SeeDance 2 günstig nutzen kannst und welche Erfahrungen ich bisher mit SeeDance 2.0 gemacht habe.

Top-Angebot: Seedance 2.0 mit 600 Videos für 24,99€

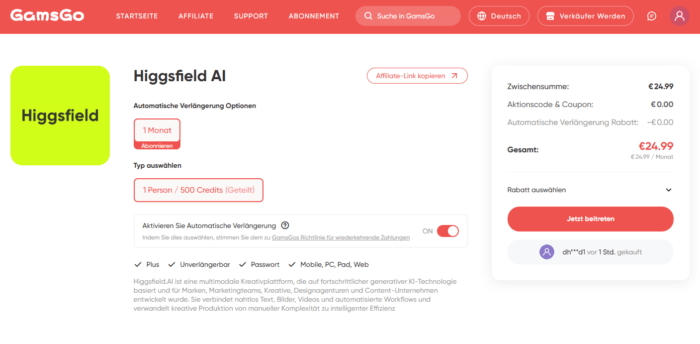

Bevor ich auf meine Erfahrungen eingehe, hier ein kurzer Tipp, wie du Seedance 2.0 sehr günstig nutzen kannst: Über die Plattform „Higgsfield” lassen sich mit „Seedance 2.0” pro Monat 600 Videos generieren. Auf der Plattform kannst du verschiedene KI-Modelle nutzen, darunter eben auch Seedance 2.0. Wenn man direkt bei Higgsfield ein Plus-Konto bestellt, zahlt man satte 40 Euro. Ich empfehle daher den Kauf eines Higgsfield-Plus-Kontos über GamsGo (24,99 Euro pro Monat).

Direkt nach der Bestellung bei GamsGo erhält man die Zugangsdaten für Higgsfield und ist Teil eines geteilten Familienkontos. Wichtig: Man hat ein eigenes Higgsfield-Konto, auf das niemand aus dem Familientarif zugreifen kann. Ich habe Higgsfield so seit einigen Monaten abonniert.

Seedance 2.0 im Test: So fühlt sich „Video-KI 3. Generation” an

In den letzten Monaten habe ich so ziemlich alles ausprobiert, was der Markt an Video-KI hergibt. Und ich sage es direkt: Bei Seedance 2.0 ist es das erste Mal, dass ich nicht nur „gute Clips” sehe, sondern echte Filmsprache.

- Nicht dieses typische KI-Geflimmer.

- Nicht „sieht cool aus, aber bricht nach 3 Sekunden”.

- Sondern: Bewegung, Kamera, Sound und Konsistenz - als hätte jemand eine neue Stufe freigeschaltet.

Was mich sofort überrascht hat

Mein erster Eindruck war eindeutig: Seedance 2.0 wirkt nicht wie ein Spielzeug, sondern wie ein System, das komplexe Abläufe wirklich versteht. Die Bewegungen fühlen sich weniger nach „Puppen-Animation” an und vor allem zerbröselt die Figur nicht nach jedem Schnitt. Hinzu kommen Kamerafahrten, die nicht permanent wie ein „Glitch” aussehen, sowie Stile, die nicht alle aus demselben KI-Baukasten zu stammen scheinen.

Beim Zuschauen hatte ich mehrfach das leicht unheimliche Gefühl, dass das Ganze gefährlich nah an das heranrückt, was für klassische Produktionen langfristig unbequem werden könnte.

UGC-Videos: Endlich Content, ohne selbst vor die Kamera zu müssen

Bei mir hat ein Showcase sofort „Klick” gemacht: UGC-Style-Videos, also Clips, die so wirken, als würde eine reale Person ein Produkt präsentieren oder etwas erklären. Dabei ist nicht nur das Bild spannend, sondern auch der Ton - und vor allem die Lippenbewegungen.

Die Stimme klingt in vielen Szenen erstaunlich natürlich, inklusive Details wie Raumklang, der sich wie Badezimmer oder Flur anhört. Selbst bei näherem Heranzoomen bleiben die Lippenbewegungen plausibel. Die Clips laufen zwar oft um die 12 Sekunden, aber es wirkt nicht so, als wäre das eine harte Grenze. Es wirkt eher so, als wäre das etwas, das man präzise steuern kann. Für mich ist das ein riesiger Schritt, da genau diese „Ich will nicht selbst ins Bild”-Use-Cases bisher fast immer nachgestellt aussahen.

Action & Kämpfe: Genau da, wo andere Modelle scheitern

Ausgerechnet da, wo es richtig schnell wird, steigen viele Videomodelle aus. Kampf-Choreografien, harte Schnitte, schnelle Bewegungen. Das ist auch der Bereich, in dem sich KI am schnellsten entlarvt - entweder, weil Bild und Ton nicht zusammenpassen, oder weil die Szene plötzlich „kippt”.

Bei Seedance 2.0 war mein Eindruck deutlich stabiler. Wenn man es trashig mag, bleibt es trashig, ist aber trotzdem konsistent. Besonders auffällig ist, dass der Sound zeitlich passender sitzt, also der Punch-Sound wirklich da ist, wo der Schlag passiert, statt „irgendwo in der Nähe”. Insgesamt wirkt es weniger wie ein Clip-Generator und mehr wie eine automatisierte Mini-Cinema-Engine.

Die „Cinema-Maschine”: Konsistente Welten fühlen sich plötzlich normal an

Für mich ist die Weltkonsistenz das stärkste Argument. Dabei bleibt nicht nur die Figur, sondern auch die Umgebung gleich. Im besten Fall wirkt es so, als hätte das System verstanden, dass es eine Szene fortsetzt - statt jedes Mal neu zu raten.

Beim Zuschauen dachte ich: „Okay, das ist nicht mehr nur Clip-Output. Das ist Kurzfilm-Produktion.“ Selbst kleine Details wie der Himmel, die Wolken oder wiederkehrende Elemente bleiben über die Szenen hinweg stabiler als bei vielen anderen Modellen. Effekte und Sound wirken zudem so, als seien sie gezielt eingesetzt worden, nicht zufällig.

Kontrolle statt Zufall: Referenzen, Frames und eigene Stimmen

Seedance 2.0 fühlt sich wie ein Werkzeugkasten für all jene an, die mehr wollen als „Prompt rein, Clip raus”. Besonders gut gefällt mir die Möglichkeit, Audio, Video oder Bilder als Referenz einzusetzen, beispielsweise um eine Stimme konsistent zu halten oder um ein Video hochzuladen und es konversationell zu bearbeiten, also um Charaktere zu tauschen oder Elemente zu verändern.

Auch das Prinzip von Start- und Endbild (First/Last Frame) ist spannend, da es den Output planbarer macht. Für mich ist das Killer-Detail jedoch, dass man eigene Stimmen mitbringen kann. Für viele Content-Formate ist das ein enormer Vorteil.

Stilvielfalt: Keine sichtbare Decke

Was ich an Seedance 2.0 fast schon „gefährlich” finde, ist, dass es wirkt, als gäbe es keine klare Stilrichtung. Ob 3D-Animation, fotorealistisch, Anime oder Cinematic mit Effekten - entscheidend ist nicht die Liste der Stile, sondern die Stabilität bei Kamerafahrten. Genau dort treten bei vielen anderen Modellen sofort Artefakte auf. In den Showcases sah das deutlich belastbarer aus..

Mein Fazit: Das ist kein „neues Modell”, das ist ein Shift

„Gamechanger” hört man ständig. Meistens ist es Marketing. Bei Seedance 2.0 hatte ich zum ersten Mal den Eindruck: Das hier ist ein echter Paradigmenwechsel.

Nicht, weil es ein bisschen besser ist. Sondern weil es Dinge gleichzeitig hinbekommt, die vorher selten zusammen gingen: Cinematic und konsistent, Audio und Lippenbewegungen und Timing, mehr Kontrolle statt Zufall - und das Ganze wirkt plötzlich bezahlbar statt luxuriös.

Sollte sich das in der Praxis bestätigen, wäre Seedance 2.0 für mich der Startschuss für eine neue Generation von Video-KIs: voll kontrollierbare, vertonte Kurzfilme, die aus Prompts und Referenzen entstehen.

Und ja - ich glaube, viele sind darauf noch nicht vorbereitet.